Accelerazione degli obiettivi Zero Trust con l'AI generativa: Guardicore AI (parte 2)

Una delle applicazioni più riconoscibili dell'AI generativa oggi disponibili sul mercato è lo sviluppo di chatbot basate sull'intelligenza artificiale (AI), come ChatGPTdi OpenAI. Questa nuova generazione di chatbot, che dispongono di funzionalità di apprendimento basate sull'AI, sta riscontrando un enorme successo di pubblico.

Si potrebbe sostenere che sia stata ChatGPT, lanciata a novembre 2022, a far conoscere al grande pubblico l'AI generativa e per una buona ragione. Il potenziale di queste chatbot stimola l'immaginazione (in meglio e in peggio) e la tecnologia continua ad evolversi man mano che gli investimenti nell'AI stanno raggiungendo i massimi record.

Questa serie di blog descrive l'uso dell'AI generativa sulla nostra piattaforma per il modello Zero Trust. Nel nostro primo blog, Accelerazione degli obiettivi Zero Trust con l'AI generativa: AI Labeling (parte 1), abbiamo presentato questa nuova funzione di etichettatura basata sull'AI. In questa seconda parte, invece, ci focalizzeremo sul raggiungimento degli obiettivi Zero Trust nel momento in cui la microsegmentazione non implica più uno sforzo principalmente manuale.

Presentazione della funzione Guardicore AI

Una chatbot generativa addestrata può risultare alquanto utile, soprattutto per velocizzare le attività manuali, chiedere le informazioni desiderate e formulare consigli pertinenti. Con questa premessa, abbiamo deciso che uno dei modi migliori per sfruttare l'AI generativa nella nostra soluzione di segmentazione leader del settore era creare una chatbot e addestrarla specificamente per assistere gli addetti alla sicurezza nei loro progetti di segmentazione Zero Trust .

Ora, siamo lieti di annunciare la presentazione della nostra nuova chatbot Guardicore AI. In breve, Guardicore AI è una chatbot generativa basata sull'AI, che dispone di eccellenti competenze integrate sulla segmentazione e sul modello Zero Trust e può fornire ottimi suggerimenti sulla cybersicurezza. Animata dall'intento dei nostri clienti di utilizzare un linguaggio naturale per interrogare le loro reti, accelerare le attività manuali e fornire loro consigli basati sulle best practice, la nostra chatbot offre una piattaforma in cui i componenti necessari del sistema Zero Trust non richiedono più sforzi manuali per essere resi operativi mediante le seguenti operazioni:

Accelerare le operazioni e fornire supporto

Fungere da consulente in materia di sicurezza.

Accelerare le operazioni e fornire supporto

La prima versione di Guardicore AI, incluse le funzionalità riportate di seguito, inizierà ad essere distribuita ai clienti esistenti nel secondo trimestre del 2024.

Analisi del traffico di rete

La prima cosa che Guardicore AI vi consentirà di fare è raccogliere informazioni su ciò che accade nella vostra rete in un dato momento. Queste informazioni sono già fornite dalla mappa Reveal, ma Guardicore AI vi consentirà di porre domande specifiche su alcuni aspetti del traffico della vostra rete, con un linguaggio naturale, e ricevere esattamente le informazioni che vi servono.

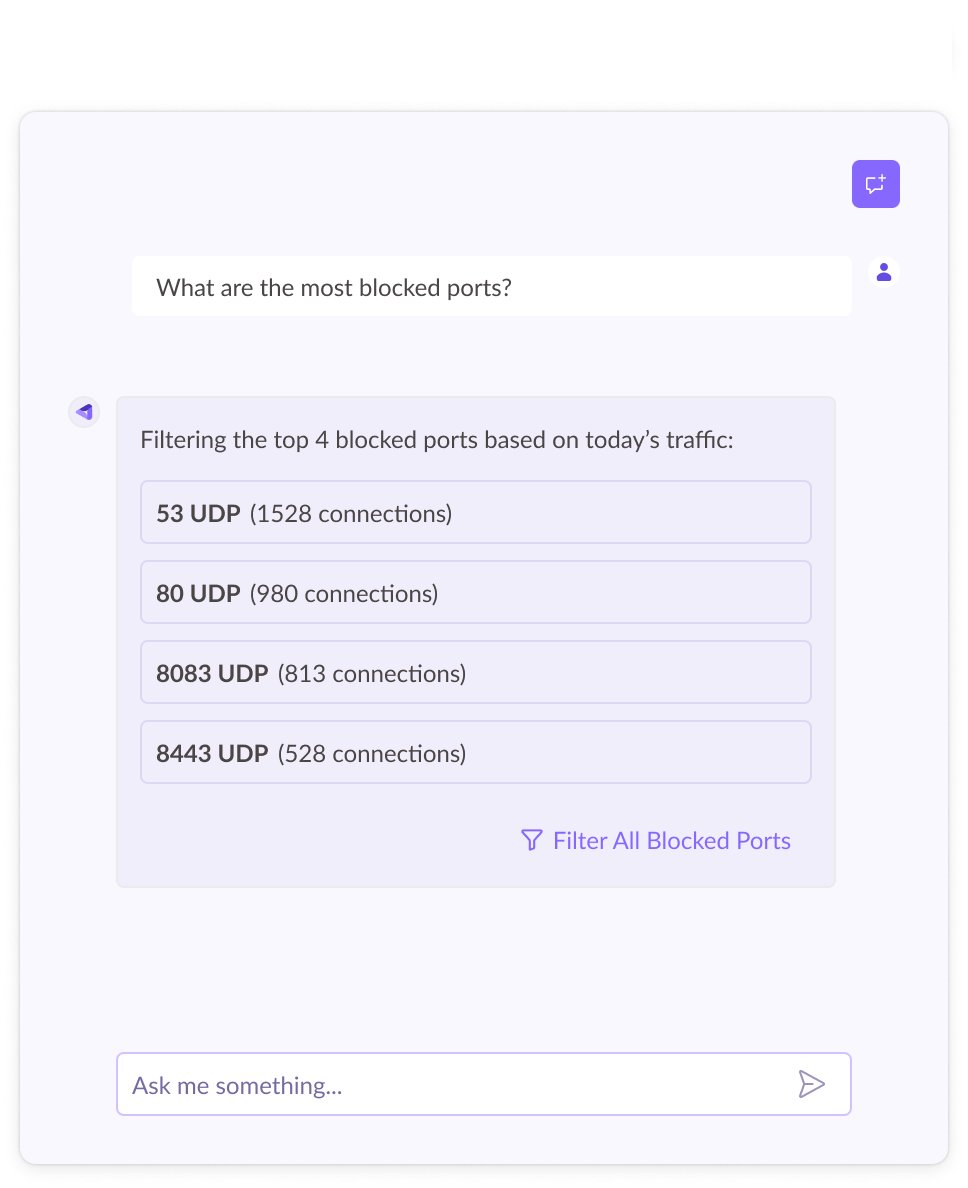

Ad esempio, potrete chiedere alla chatbot una semplice domanda del tipo "Quali sono le porte che vengono bloccate più frequentemente?" e ricevere rapidamente una risposta esauriente (Figura 1).

Registri di rete e filtri per la mappa

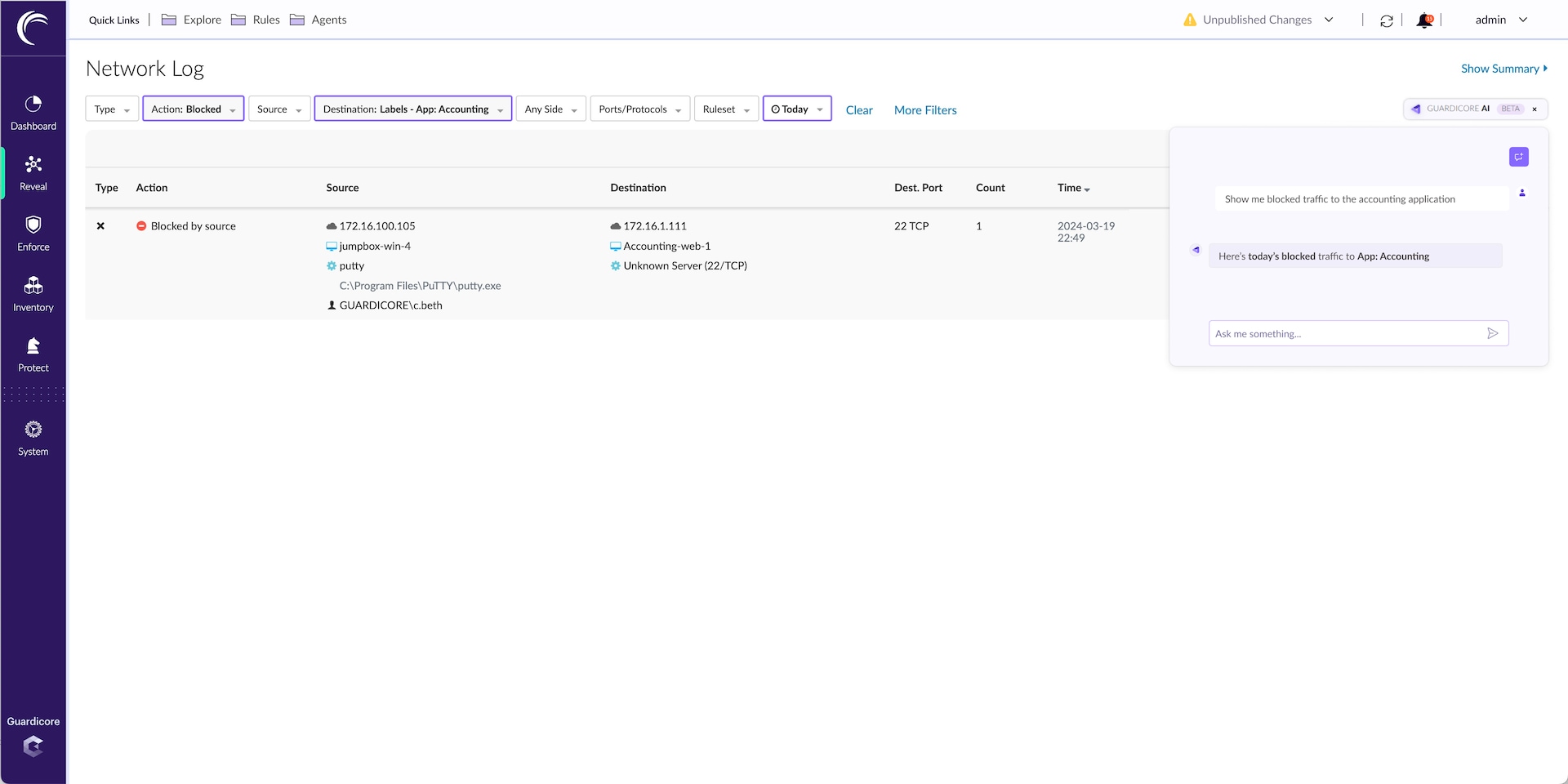

Potrete anche interrogare i registri di rete per informazioni specifiche, quindi utilizzare tali informazioni per creare filtri per la mappa Reveal (Figura 2), che vi consentiranno di visualizzare le informazioni desiderate nell'intento di fornire un miglior livello di comprensione e condivisione delle conoscenze.

Fungere da consulente in materia di sicurezza

La nostra visione della funzione Guardicore AI va ben oltre l'analisi e le query. Il nostro intento è fornire una chatbot in grado di fungere da guida e da consulente per gli utenti che cercano di progredire realmente nel loro percorso di adozione del modello Zero Trust per contribuire ad accelerare i progetti di segmentazione e ridurre i tempi di implementazione delle policy.

Disporre della capacità di implementare la segmentazione in modo più rapido e semplice eliminerà alcuni dei principali ostacoli che si frappongono alla completa implementazione del sistema Zero Trust nei moderni ambienti IT, ridurrà significativamente la superficie di attacco complessiva e impedirà il successo degli attacchi ransomware e di altre minacce.

Tra le funzionalità incluse in Guardicore AI, ad esempio, figurano le seguenti:

Analisi dettagliate della rete e dei dati di implementazione della soluzione (dati sul traffico, risorse, etichette, ecc.)

Guida sulle best practice utili per rendere operativa la soluzione Akamai Guardicore Segmentation

Suggerimenti sulle aree o sulle applicazioni da segmentare in un secondo momento

Suggerimenti su come mitigare le CVE più recenti con Akamai Guardicore Segmentation

Assistenza su come risolvere i problemi della soluzione

Generazione di query SQL dal linguaggio naturale per Insight

Conversione del linguaggio naturale in query SDL per Insight

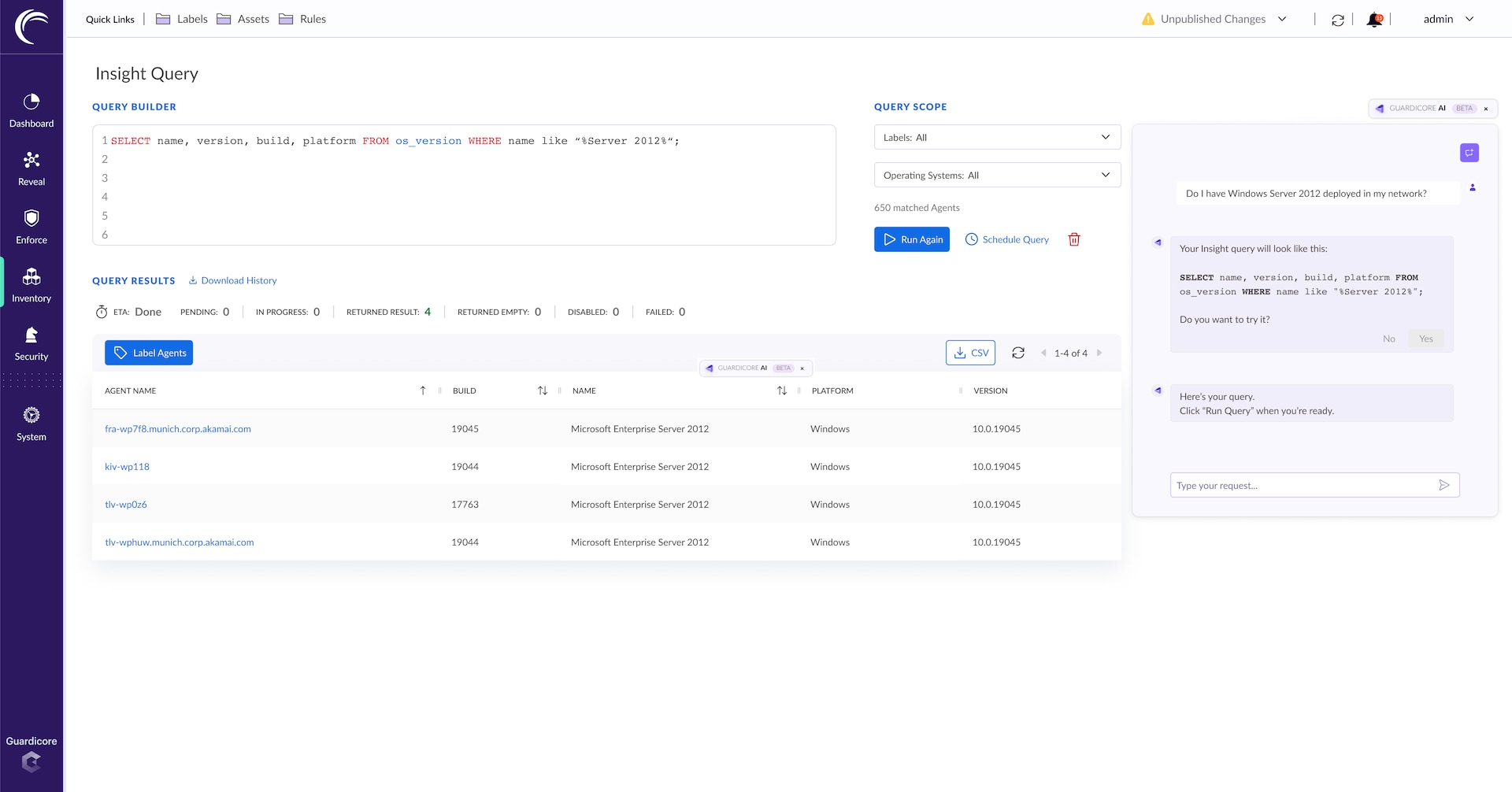

I clienti che utilizzano la nostra funzione Insight (il nostro motore basato su OSquery per la raccolta del contesto in tempo reale dalle risorse che comunicano in rete) potranno presto creare query utilizzando un linguaggio naturale.

Si tratterà di una funzionalità con un enorme valore aggiunto per i nostri clienti, poiché uno dei principali ostacoli alla diffusione dell'utilizzo di Insight è legato alla necessità di porre le query come comandi SQL. Pertanto, è necessario che qualcuno nel team conosca e sappia come generare query in SQL, anche se, tuttavia, ciò non dovrebbe essere un prerequisito per trarre il massimo vantaggio da questa funzionalità.

Nella Figura 3, viene illustrato un esempio di come la funzione Guardicore AI sarà in grado di convertire il linguaggio naturale in un comando SQL da poter poi utilizzare in Insight per generare le informazioni desiderate.

Casi di utilizzo della funzione Guardicore AI

Quindi, quali sono le aree in cui i nostri clienti possono trarre vantaggio da una funzione generativa basata sull'intelligenza artificiale come Guardicore AI? Di seguito, vengono riportati tre esempi di casi di utilizzo:

Assistenza sui requisiti di conformità

Risposta alle minacce

Valutazione delle vulnerabilità

Assistenza sui requisiti di conformità

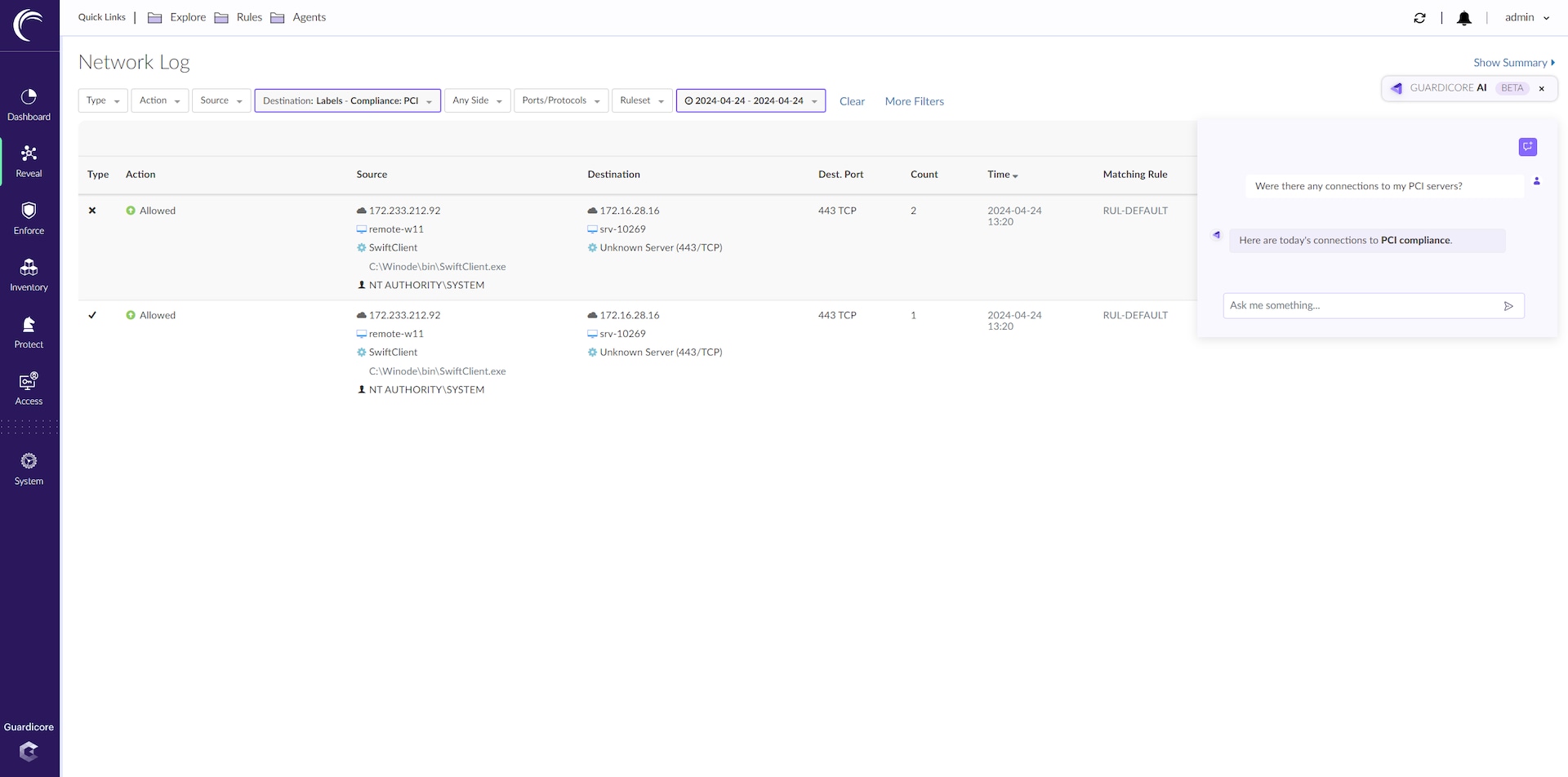

Molte normative in materia di conformità, come il PCI DSS, richiedono che tutti i sistemi che archiviano, elaborano o trasmettono dati sensibili (come i dati delle carte di pagamento) siano isolati dal resto dell'ambiente IT. Questo requisito ha un fondamento logico e offre chiari vantaggi in termini di sicurezza, ma la sua implementazione può risultare difficile. Individuare ogni sistema rilevante e attestarne la conformità è difficile nelle organizzazioni che dispongono di reti sofisticate e di grandi dimensioni. Inoltre, la raccolta e la correlazione delle informazioni pertinenti è un'operazione dispendiosa in termini di tempo e gli addetti alla sicurezza devono essere in grado di accedere facilmente ai dati desiderati.

In questi casi, la funzione Guardicore AI può aiutarvi. Potrete dare istruzioni in un linguaggio naturale per ottenere rapidamente informazioni importanti e pertinenti sulle connessioni ai server PCI presenti nella vostra rete (Figura 4). Questi dati possono anche essere visualizzati in modo cronologico in modo da poter immediatamente attestarne la conformità per un periodo specifico , consentendo ai team dedicati a questa attività di risparmiare enormi quantità di tempo.

Risposta alle minacce

Quando un'organizzazione sospetta di essere sotto attacco, il tempo diventa la risorsa più preziosa: individuare la minaccia e avviare le appropriate operazioni di analisi e risoluzione del problema diventa una corsa contro il tempo. In genere, a tal scopo sono richiesti l'utilizzo di più prodotti mirati e la disponibilità tempestiva di dati completi, oltre ad appropriate competenze tecniche. Gli addetti alla sicurezza hanno bisogno di un modo migliore per indagare e rispondere agli incidenti rapidamente, nonché da un'unica piattaforma.

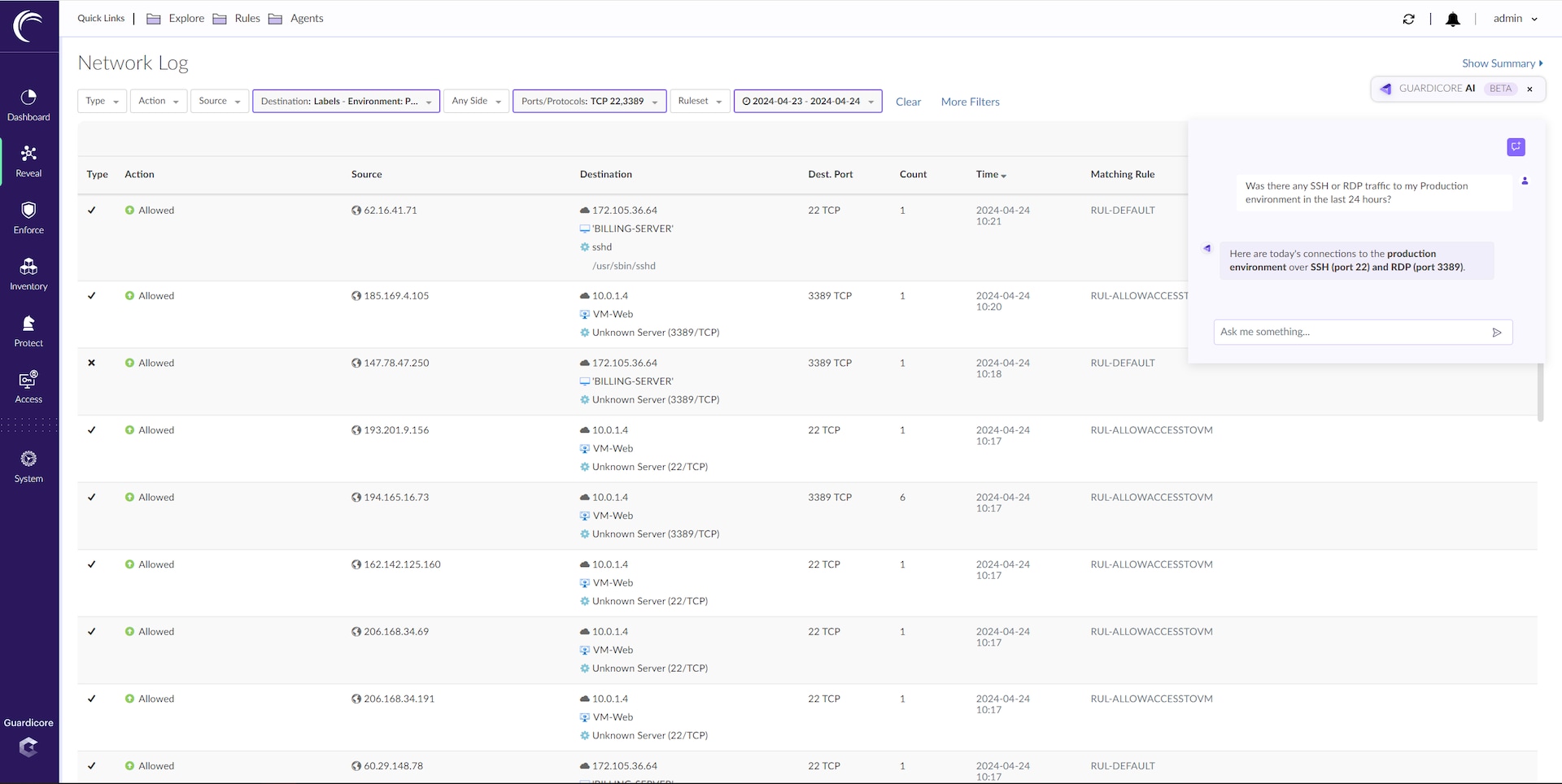

Anche in questi casi, Guardicore AI può aiutarvi. Ora, potete dare istruzioni in un linguaggio naturale per indagare sul traffico sospetto o per far emergere eventuali comunicazioni dei processi potenzialmente utilizzate in modo improprio dai criminali, come i protocolli SSH (Secure Shell) o RDP (Remote Desktop Protocol) , che vengono frequentemente violati (Figura 5).

Valutazione delle vulnerabilità

I criminali sono costantemente alla ricerca di lacune di sicurezza nei sistemi IT, pertanto sorgeranno sempre nuove vulnerabilità che i team addetti alla sicurezza dovranno gestire, come Log4j e XZ Utils. Di conseguenza, una gestione efficace delle vulnerabilità è essenziale per proteggere in modo proattivo ambienti IT sempre più complessi. Esistono soluzioni disponibili per affrontare questo problema, ma quasi nessuna di esse è orientata al modello Zero Trust, né sfrutta la microsegmentazione per proteggere i sistemi potenzialmente vulnerabili.

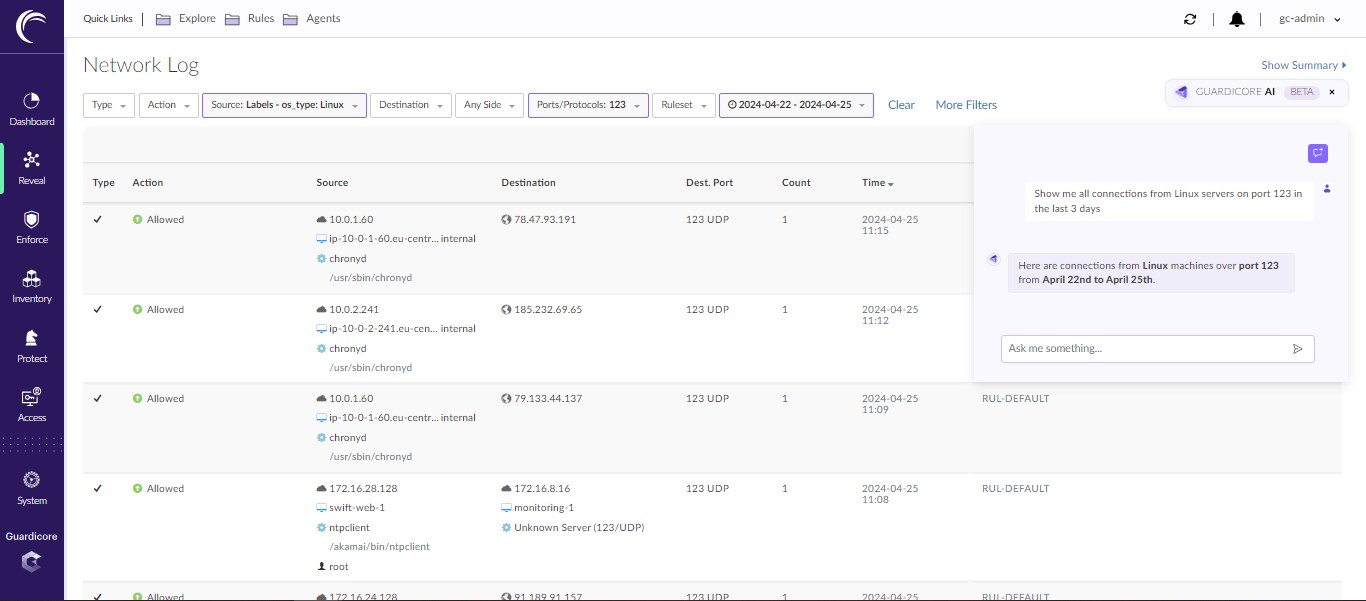

Come nel caso della risposta generale alle minacce, il tempo è il fattore più importante quando si cerca di gestire una nuova vulnerabilità e, anche in questo contesto, Guardicore AI può aiutarvi. Ad esempio, se viene annunciata una nuova vulnerabilità che, generalmente, colpisce i sistemi Linux, la funzione Guardicore AI può aiutare i vostri team nella valutazione di questa vulnerabilità. Con un solo comando impartito in un linguaggio naturale, la chatbot sarà in grado di far emergere tutte le connessioni stabilite a tutti i sistemi Linux presenti nella vostra rete (Figura 6).

Una policy appropriata potrà quindi essere applicata rapidamente a questi sistemi per fungere da patch virtualee proteggere i vostri sistemi finché non viene distribuita una correzione o una patch permanente. Questo è solo un altro esempio del vantaggio apportato in termini di sicurezza dallo sfruttamento dell'AI generativa per facilitare le operazioni e l'adozione del modello Zero Trust.

Conclusione

Una delle difficoltà legate all'implementazione del modello Zero Trust in un ambiente aziendale di grandi dimensioni è la quantità di lavoro necessaria per raggiungere il livello di sicurezza desiderato poiché sono richieste molte attività manuali e operazioni costanti di monitoraggio e amministrazione di diverse infrastrutture.

Riteniamo che, per raggiungere gli obiettivi Zero Trust, la maggior parte del lavoro manuale dovrà essere assistito da una funzionalità o applicazione di AI generativa, che rimuoverà uno dei maggiori ostacoli all'adozione del modello Zero Trust. Il nostro obiettivo è fornire una piattaforma in cui la segmentazione e altri componenti necessari del modello Zero Trust richiedano una minore quantità di lavoro manuale per essere resi operativi.

Scoprite di più

Scoprite ulteriori informazioni sulla nostra piattaforma Zero Trustbasata sull'AI.